内容来自于“https://magazine.reallusion.com/”

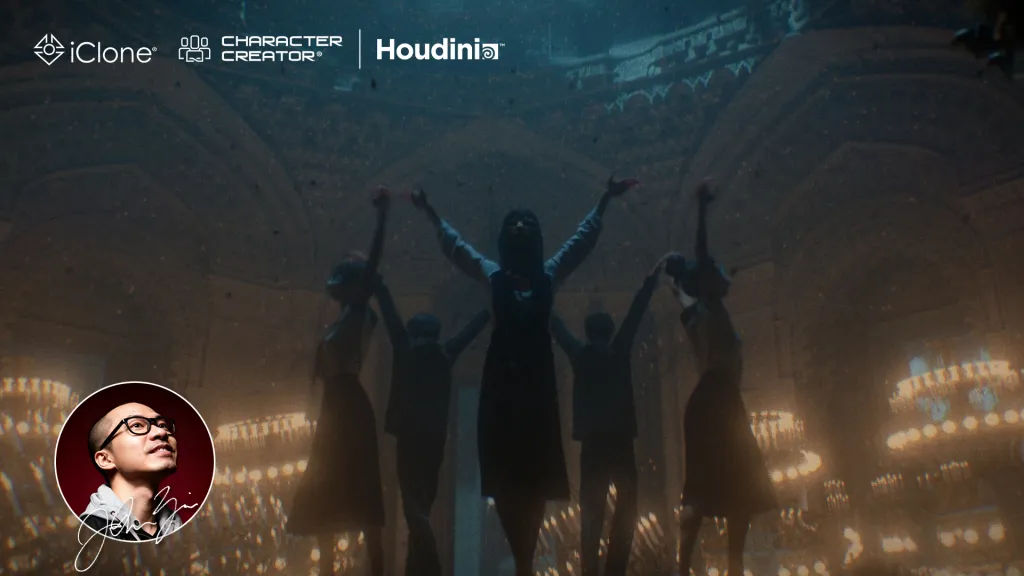

约翰·严

大家好,我是约翰·严。身为注册建筑师兼CGI艺术家,我常驻伦敦。对创造美学影像的痴迷,使我的创作热情从建筑领域延伸至时装设计、角色设计与景观设计,多元视角与丰富影响不断拓展着我的艺术视野。作为建筑师,古典建筑与芭蕾舞深深烙印在我的艺术基因里——我始终着迷于华丽繁复的建筑与优雅流畅的芭蕾舞姿之间那份浑然天成的共鸣。

与此同时,现代动漫作品成为我个人创作的最大灵感源泉——其影响力甚至超越真人电影与CG动画。在所有观赏过的动漫中,舞蹈场景最能捕捉这种媒介的精髓:唯有当动画师完全掌控每一帧过渡与静止瞬间时,才能呈现出独特的能量、迷人的韵律与灵动趣味。这些瞬间所诠释的动漫精神,始终与我内心产生深刻共鸣。

“Big Heart”项目最初只是一个简单的周末实验,源于我在Reallusion ActorCore上发现的一部充满趣味的动作捕捉动画。随着细节不断丰富,并从音乐视频中汲取灵感,它逐渐演变为我迄今为止最具野心的CG项目之一,耗时近一年完成。我渴望将自身两个面向——动漫爱好者与建筑师——融合于这个奇幻的CGI创作之中。

Character Creation 和 Character Animation

在我使用的所有3D软件中,CC、iClone和Marvelous Designer至今仍是我未用Houdini替代的工具。Houdini的角色绑定与动画功能虽强大,却过于技术化且违背直觉。由于缺乏正式的绑定或动画培训,CC和iClone更能满足我的需求。其直观的界面让我能专注于艺术创作,而非深陷技术难题的泥潭。

我通过在CC中创建两个角色启动了项目,利用身体形态调整器修改了他们的身高、体型和面部特征。随后将角色导出至iClone,从ActorCore下载了三组动作素材并进行混合处理,以此创建了初始动画序列。这些素材最终构成了动画的完整序列,此外我还逐步添加了几组动作素材作为补充。

编辑动作图层是我最常用的iClone工具。它能让我通过反向运动学关节手动设置角色动作的关键帧,这点至关重要——尤其在后续模拟中,需要精细调整角色手部动作以避免与服装发生碰撞。

回顾我早期的作品《变身》和《嬉戏神灵》,一个显著的批评在于角色们的外形和动作如出一辙——有时甚至产生一种诡异的效果。实际上,即便是经过最充分排练的舞者,动作中也存在自然的差异。

为在不显著增加渲染时间的前提下实现角色多样性,我采用了两个基础角色模型(一男一女)、五种发型以及三套服装变体。这种方案既能避免角色面容雷同引发的诡异感,又保持了舞蹈团的视觉统一性。动作设计方面,我通过两种方式对动作捕捉数据进行调整:在动作捕捉数据上叠加关键帧层,或微调动作捕捉关键点。我认为微妙的差异化处理最为理想,因为完美同步的动作具有某种迷人的魅力,而过度变化反而会分散观众注意力。

布料模拟

我使用Marvelous Designer进行初始布料拟合,并借助Houdini添加细节(缝线、下摆、衣物厚度、拉链和纽扣)。尽管Houdini完全能够从零开始创建服装,但它仍缺乏Marvelous Designer的实时反馈功能,这在布料拟合过程中会打断我的创作流程。

制作服装时有两点至关重要。首先,我尽量避免布料重叠——Houdini中的Vellum材质极其厌恶几何体重叠。其次,粒子密度设置需要精心考量。我将粒子间距固定在至少10个单位。许多教程建议将其调至2单位以增强细节,但我发现这只会导致模拟时间暴增却收效甚微。10单位对我而言是最佳平衡点。

待所有服装适配角色A姿态后,我将所有模型转换为四边形网格,并直接导出为焊接OBJ文件导入Houdini——因为OBJ是唯一能在导出时完整保留Marvelous Designer材质数据的格式。导入的OBJ文件按材质拆分后,为每块布料赋予不同的Vellum属性。随后绘制遮罩控制模拟区域:通常将整个背部和腰部区域遮罩掉,并通过点变形将这些部位直接绑定到角色动画上。这种混合设置使部分区域严格跟随角色动作,其余部位则自由模拟。

虽然许多Houdini艺术家倾向于在运行Vellum前使用Remesh节点将所有网格转换为三角形——因三角形能以更少顶点捕捉更多细节——但我个人更偏好四边形网格,因为它们在大多数情况下表现足够出色,且无需在渲染时费力将三角形网格重新变形回四边形网格。

Vellum参数与现实世界数值不对应,其行为会随网格密度变化,因此要实现特定织物外观需要大量反复试验。最终模拟时,我通常采用20个子步长和200-400次约束迭代进行多层布料模拟。当模拟效果令人满意后(这个迭代过程耗时数月),只需使用点变形工具将纽扣、链条、缝线和接缝细节附加到模拟服装上即可。

头发模拟

为准备头发模拟,我以iClone头发网格为基础,使用GitHub上找到的HDA工具“Cards to Curves”——这是Houdini中转换头发网格的简易方案。在早期测试模拟中,我发现除主角的长发外,其他发型即使被风吹动也缺乏足够动态变化,难以产生明显效果。因此我仅对长发进行模拟,其余从iClone导出的发网均保持原样未作修改。关键经验在于必须添加“粘合”维勒姆约束,防止单根发丝在模拟中过度分离。同时运用“固定到目标”维勒姆约束将发顶固定于头皮,有效缩短了模拟时间。

FX模拟

我使用Axiom Solver进行火焰模拟,并采用Embergen处理雾效与冲击波模拟。为增强最终镜头层次感,我尝试用Embergen创建地面雾效。先导出动画角色与环境的简化多边形几何体,再将其导入Embergen作为碰撞几何体。雾效通过带随机涡流噪声的盒体体积生成。碰撞几何体将与雾场产生交互作用。随后我将模拟生成的雾场以VDB格式导出至Houdini。

最终镜头中的心形冲击波同样采用Embergen预设生成,仅将辐射源替换为心形几何体。随后将体积数据导出为VDB格式,粒子导出为Alembic格式至Houdini。最终渲染时为粒子添加发光材质,在VDB冲击波之上叠加了额外的细节层次。

由于Axiom和Embergen都是极其高效的火光解算器,本项目特效模拟的挑战重点已从优化模拟时间转向精确把控时序——尤其针对冲击波效果这类快速模拟场景。我并未在Embergen中反复进行模拟,而是运用Houdini的“retime”和“timeshift”功能调整体积数据集的时序,使其与舞蹈整体节奏完美契合,最终呈现出令人满意的效果。

某些镜头中的动态元素较少。为确保整个序列保持连贯的动画感与动态效果,我在所有镜头中添加了飘落的花瓣。这些花瓣采用Houdini Vellum模拟技术制作,基本在所有序列中重复使用。这一添加也增强了最终渲染的奇幻质感。

场景环境

场景灵感源自托斯卡纳的萨梅扎诺城堡——摩尔复兴建筑的典范之作。这座拥有365间房间的城堡,每间都装饰着独特精美的摩尔风格装饰,可惜如今已成废墟。

为致敬这座非凡的室内空间,五年前我便开始用Rhino重构其若干双层空间。但因模型体量庞大,直至近期才得以将其融入动画序列。实现模型可用的突破方案其实很简单:借助渲染农场对模型执行多边形简化操作。此前我从未想到渲染农场还能用于Houdini操作,而不仅限于渲染本身。这让我免去了无数次崩溃和头疼。

渲染

当所有模拟效果令我满意后,我将全部内容导出为Redshift代理。这实质上是对渲染几何体进行预处理,在仅剩光照与材质变量的迭代渲染测试阶段节省了大量时间。根据测试渲染结果估算,若使用双4090显卡的本地工作站连续渲染,至少需要六个月时间。这显然不切实际,因为在此期间我仍需使用工作站处理其他项目。

经深入排查,我发现“散景效果”是导致渲染耗时过长的元凶。仅通过关闭散景功能,最终渲染时间便从6个月缩短至不足2个月。当前阶段的剩余挑战是在Nuke中为所有渲染序列合成景深效果——这项工作我已拖延多年。

合成

掌握Nuke合成技术是我今年的个人目标之一,而它对本项目至关重要——尤其在缩短渲染时间方面。我主要用Nuke为最终渲染图添加景深效果、镜头/热浪畸变以及色差效果。

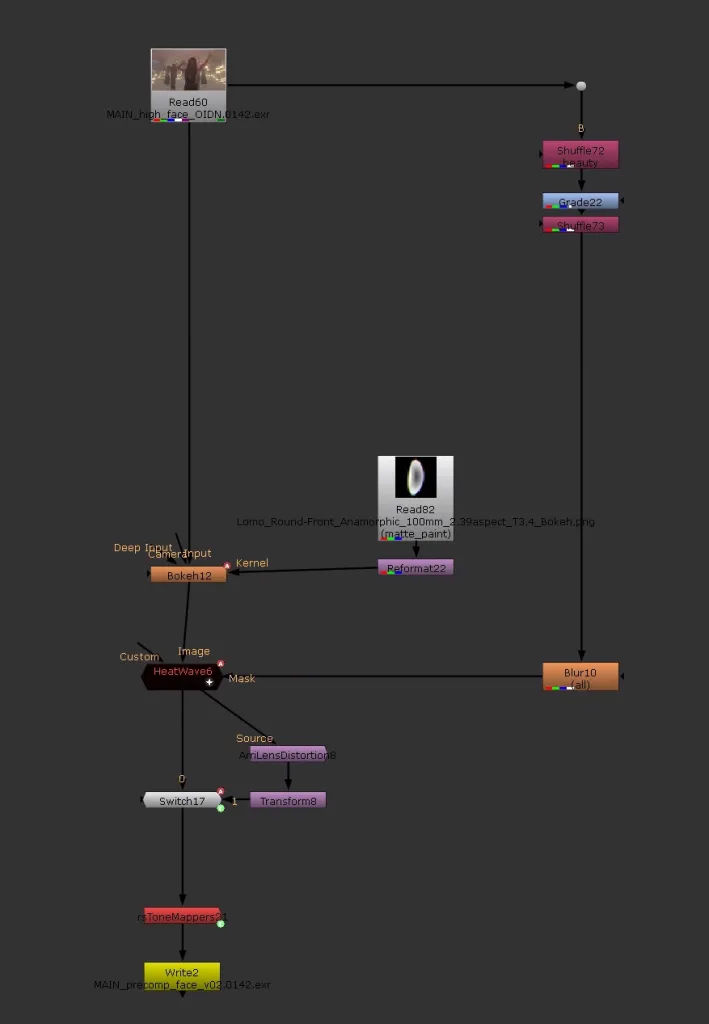

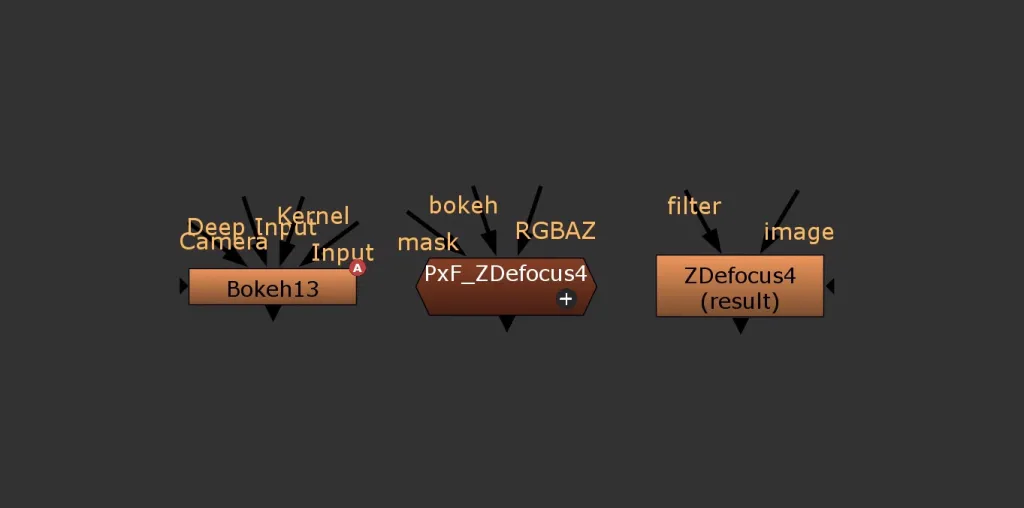

左侧是Nuke中典型的脚本示例。在测试了ZDepth、Pxf_ZDepth和Bokeh三个不同节点后,我最终将选择范围缩小到Pxf_ZDepth或Bokeh。

Pxf_ZDepth能提供近乎实时的优质效果,使用体验相当愉悦,尤其支持直接在屏幕上选取焦点平面并将其移至选定位置的功能。Bokeh虽能输出最高质量效果,但运行速度远逊于Pxf_ZDepth,且缺乏交互式焦平面选择功能。我选择在前期制作阶段使用Pxf_ZDepth保持工作流效率,最终渲染时切换至Bokeh以获得最佳画质。

今年另一项个人目标是从Adobe Premiere Pro转用DaVinci Resolve,因其在剪辑速度、功能丰富度及调色性能方面全面领先。Resolve支持直接导入Nuke生成的ACEScg渲染文件进行非破坏性调色,其内置降噪功能堪比第三方插件Neat Video(Premiere Pro需单独购买)。此外,Resolve的视频导出速度提升数倍。唯一障碍在于需要重新培养肌肉记忆。

后记

《Big Heart》是我迄今为止耗时最长的项目之一,从构思到完成历时近一年。该项目最核心的收获在于:通过对发型、服装和动作的细微调整,能够实现显著的视觉提升;同时,合成技术为CG项目带来的效率提升也令人印象深刻。 这个项目让我更加确信Houdini程序化工作流的强大——建立好流程后,我能在Houdini和iClone之间反复迭代更新表情和动作,无需重新设置技术参数。

尽管欣赏iClone动画操作的直观性,但在调整姿势时无法实时查看服装与发丝变化始终是个痛点。我计划将iClone与Houdini原生绑定系统深度整合以解决此问题,尤其借助Houdini 21新增的机器学习模拟工具——尽管这条路充满挑战,但我已做好探索的准备。

撰写本文时,Reallusion AI Render也已发布。与众多网络艺术家一样,我最初对泛滥的人工智能图像和视频持强烈保留态度——这些作品大多缺乏艺术意图,代表着低投入产出的产物……与艺术精神背道而驰。然而iClone中的Reallusion AI Render展现了全新级别的控制力,证明艺术家可通过ComfyUI对生成式AI进行艺术指导。我开展了一周实验性项目,融合CG与AI工具,将自己与CG模型置入专业摄影场景。

AI主要用于迭代表情设计及最终渲染的分辨率提升。尽管需要投入大量精力对抗AI幻觉并控制输出结果,但我相信随着精细控制技术的进步,AI渲染与ComfyUI将成为CG艺术家工具箱中的强力武器。随着Reallusion Character Creator 5的发布,新增的ActorMIXER功能和更精细的皮肤纹理,使得为多人场景创建角色变体变得轻松许多。我非常期待在未来项目中探索将AI渲染与Character Creator 5整合到工作流程中的可能性。

用户评论 (0)