内容来自于“https://magazine.reallusion.com/”

John Blalock

约翰的背景和教育都是在传统的视觉效果,主要是一名合成师。多年来,他曾在Rhythm&Hues等视觉特效工作室和游戏公司Sony Playstation工作。

当他享受这些工作室的经历时,他发现了一种更大的热爱,那就是传递他所学到的东西。他在南加州的大学教育部门任教超过12年,其中包括艺术学院大学。

从那以后,他一直被它们的可能性和与其他工具的集成所吸引,如iClone和Character Creator。John还是YouTube频道AsArt的联合创始人,还经营着一个以教程为基础的频道JohnnyHowTo。他很希望你能来和他一起冒险!

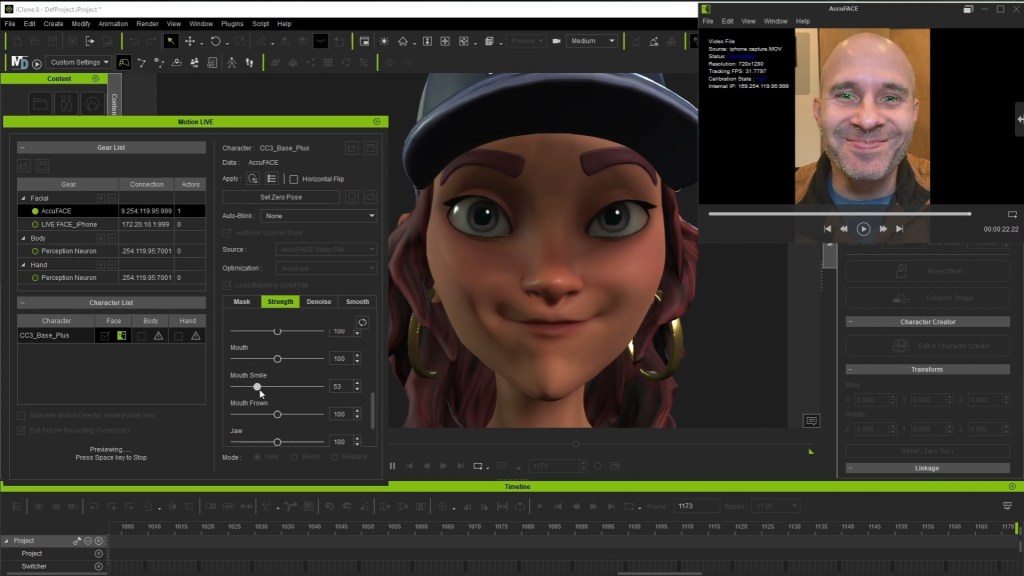

iClone AccuFace mocap工作流程

AccuFace的一大特点是它集成到iClone的Motion LIVE系统中。这使得界面直观且易于使用。除了想花一些时间了解基于视频的运动捕捉的整体考虑因素外,一切都像“一切如常”。与我使用过的其他独立捕获系统相比,这大大简化了整个过程,以提供在更短的时间内带来所需结果的创造力。

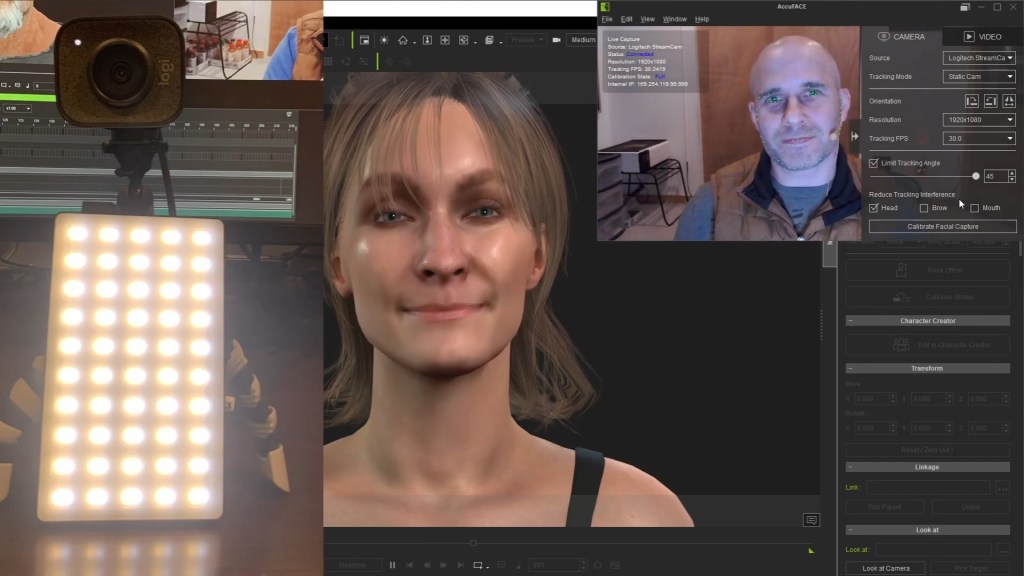

由于iClone处理所有内容并将其直接应用于角色,可能会同时合并面部和身体mocap,因此您不会遇到其他解决方案可能出现的任何管道问题。我几乎使用了手头上所有的捕捉硬件:一个用于视频的网络摄像头,一个用于消除阴影的LED灯,以及一个用于保持相机头部水平的迷你三脚架。这些东西相对便宜,所以即使是新买的,也不会倾家荡产。然而,我将在下面分享一些总体考虑因素。

Lighting matters

对于AccuFace,我一直使用LED灯来确保照明均匀,并最大限度地减少阴影,无论使用什么相机——除非使用像Razer Kiyo这样的内置环形灯。脸上的阴影可能会影响跟踪的准确性或一致性,因此消除阴影至关重要。提供最佳的“源材料”(即捕捉环境)至关重要,而适当的照明设置是我们可以采取的简单步骤。

除了照明之外,你还希望相机与人脸直接对齐,这样它就可以以自然的角度捕捉到一切。如果相机的位置太高或太低,它可能无法以适当的比例准确捕捉嘴巴运动或眨眼等细节。如果我使用的是静态相机,我通常会将其连接到一个迷你三脚架上以提升它。我经常发现自己在AccuFace中使用“减少跟踪干扰”>“头部”选项,否则,我的眉毛运动往往会影响整个头部运动。

AccuFace面板

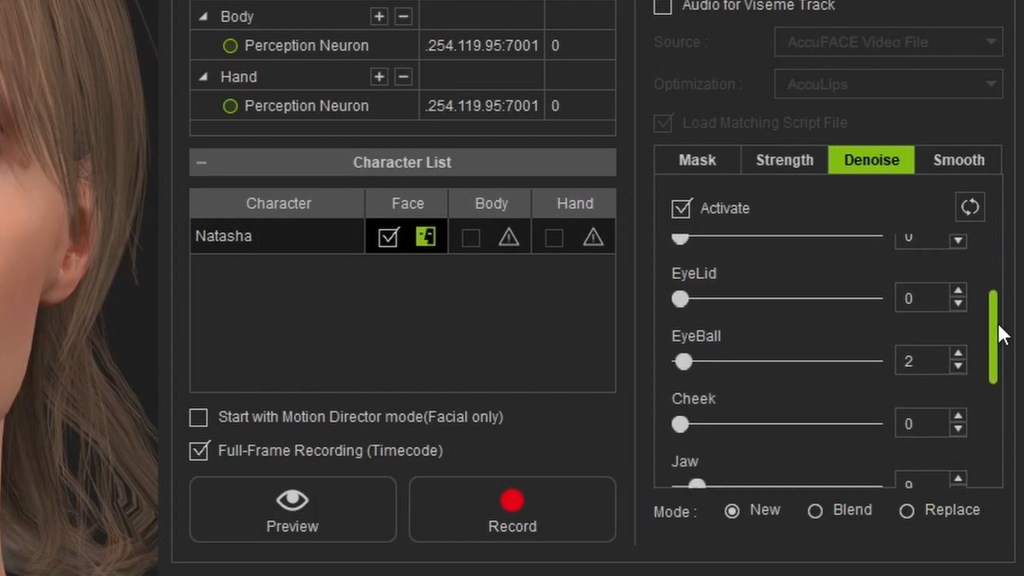

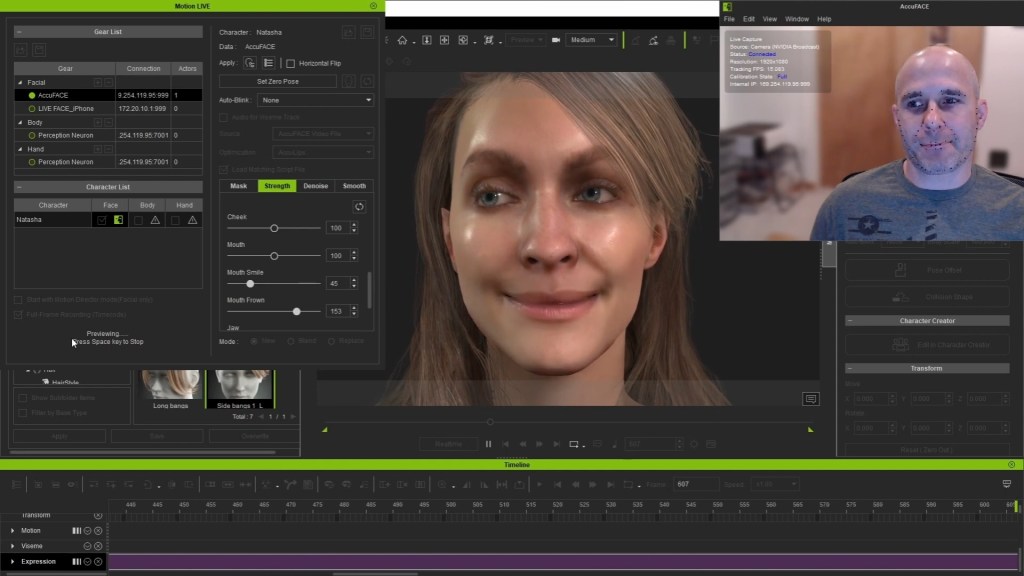

在iClone端,没有太多新的东西可以考虑,因为我之前使用过iPhone Motion LIVE配置文件,而且界面非常相似。要使用该模块,您可以在Motion LIVE中激活它,将其分配给角色,然后访问一些选项卡,如果需要,您可以过滤传入的数据。在开始调整“强度”、“去噪”和“平滑”等设置之前,我建议您先执行一个示例捕获,看看效果如何。如果视频中的照明和角度是稳定的,您可能不需要调整任何其他内容,但请放心,如果需要,这些选项卡会为您提供帮助。

AccuFace实时捕捉mocap提示

我上面提到的大部分内容都适用于现场和预先录制的视频捕捉,这里和那里有一些注意事项。在处理实时捕获时,确保一切都设置得理想至关重要,因为……它是实时捕获的!这里的简单解决方案是在录制“真实”之前进行一些试运行,并观察应用于角色时的所有内容。

我发现自己调整了几次变形的强度,并做了其他各种各样的调整来优化结果。由于使用AccuFace的网络摄像头很容易,我们许多人可能更喜欢在显示器上“留在原处”,但通常这个角度太高了。锁定角度和灯光将使你免于大量的手动调整,或者不得不重新开始,所以设置时间绝对是值得的。

我还发现访问我的网络摄像头的高级设置非常有用,尽管该选项的位置可能会因网络摄像头型号而异。对我来说,取消“弱光补偿”设置改善了视频捕捉。虽然这种设置提高了低光环境下的视频清晰度,但它往往会使镜头看起来更“模糊”,这种方式我通常会联想到网络摄像头镜头。如果照明充足,这种设置应该是不必要的,这强调了使用LED灯或类似解决方案的重要性。

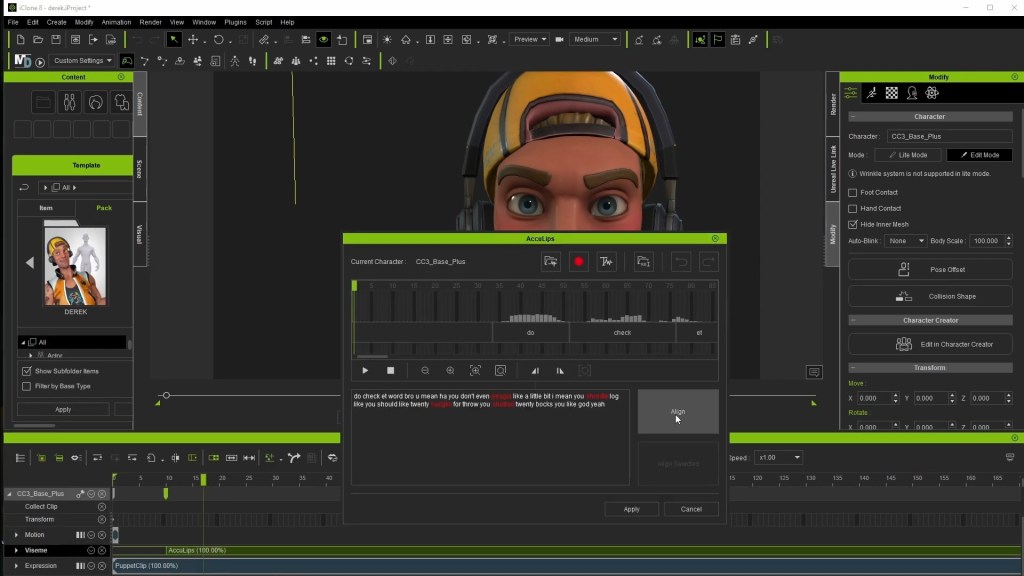

Viseme的音频选项非常有用,至少对我来说,是我在对话中经常使用的。这是因为我们的捕捉与用于lipsync动画的iClone AccuLips集成在一起。它为讲话提供了更明确的嘴部运动,如果你觉得它太明显,它对动画的影响可以在iClone中调低。花时间做校准面部捕捉姿势也很重要:增强的效果比你花10到30秒来完成它们更值得!

使用AccuFace预录制视频的技巧

我很欣赏我们可以在AccuFace中使用预先录制的视频,因为它为我们提供了很多选择。在一个方面,它可以是一个有点棘手的“锁定”设置,因为你可能不知道镜头看起来像什么,直到你事后在电脑上查看它。许多相机上的微型显示器可能会使准确评估事物的外观变得具有挑战性,并且根据拍摄地点的照明情况,你甚至可能不信任预览显示。

基于手机的视频审查效果更好,因为你有更大的屏幕,但理想情况下(几乎在所有情况下),手边有一台笔记本电脑这样的东西会很有用,你可以加载一些样本剪辑,并查看它们在更大的显示器上的外观。这种做法在电影拍摄中也很常见,所以我并不认为这是一种限制,而是一种“最佳实践”预防措施。

作为检查设置的一个例子:当我使用GoPro进行头盔捕捉时,我在提交“真实”拍摄之前将几个样本剪辑加载到PC上。这是一个有点痛苦,因为我不得不操纵的头盔钻机卡,但它证明是值得的努力。最初的镜头有点太暗,颗粒/噪音太大,这可能很好,但对于特征跟踪来说不够理想。

在对相机做了一些调整后,事情看起来好多了,我可以继续对预期的结果更有信心。最后也是最重要的一点:不要忘了记录你的姿势以备校准。这可能很容易忘记,但在你开始“真正”录音之前,这是值得做的。

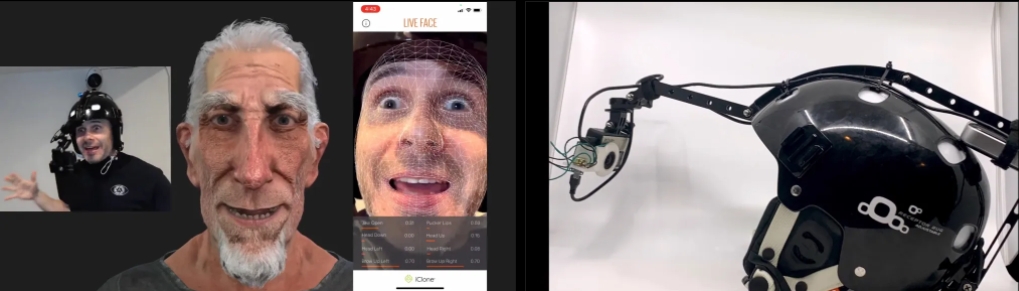

头盔mocap对比:Live Face vs AccuFace + GoPro

我观察过iClone用户之间关于他们的偏好的讨论iPhone LIVE Face和AccuFace解决方案。当谈到头盔摄像头选项时,选择取决于您可以访问的内容。我个人使用相对古老的GoPro Hero Silver,这是一款超轻量级的相机,是头盔相机的绝佳选择。这种摄像机用于各种专业头盔设置。

配备TrueDepth传感器的iPhone也是一个可行的选择,正如Epic Games等公司的项目所示。这两种设备都可以提供很好的结果,但我发现“GoPro连接到头盔”的解决方案比将iPhone捆绑并悬挂在我的头前要舒服得多。iPhone的重量变得很明显,我发现自己在调整自己的性能以进行补偿——这并不理想。使用带有AccuFace的轻型摄像机缓解了这个问题,并为AccuFace提供了一个显著的优势。

另一方面,我认为使用iPhone Live Face比使用相机录制有两个主要优势。至少在我的设想中,一个是同步。除非你有一个轻便的“动作相机”,可以作为无线网络摄像头,那么你将不得不试图找出身体mocap与面部表现的关系。

另一个主要考虑是照明设备,而且由于支持TrueDepth的iPhones使用深度传感器,它们不会受到光线变化的太大影响。这里的AccuFace解决方案是一个安装在摄像头上的灯,这是可能的,但需要额外的努力才能实现(并且会增加更多的重量)。我希望我上面写的能给你一些想法和见解来享受这些新工具!

用户评论 (0)